Datu(a) Smart Digital: inteligencia artificial para la analítica de datos en la industria

La compañía integrada en el Grupo Merkatu ha resultado ganadora del reto lanzado por GHI Smart Furnaces a través de Bizkaia Open Future

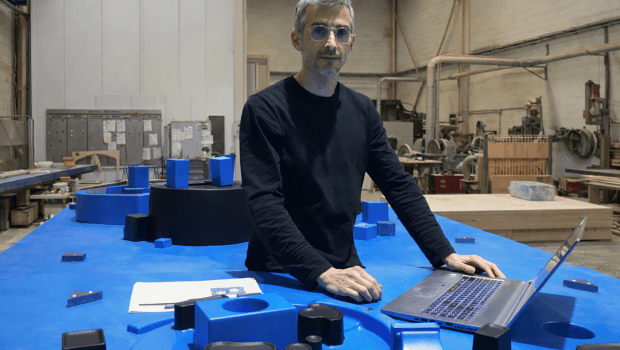

Datu(a) Smart Digital es una compañía donostiarra que tiene como origen la ‘startup’ Mathematics for Life (M4L) creada hace dos años con el objetivo de aplicar técnicas matemáticas de última generación sobre los datos para dar respuestas de alto valor añadido. Tras entrar Merkatu Smart Digital en su capital hace unos meses, ahora, Datu(a) se define como la división del dato del Grupo Merkatu. Conversamos con Alberto Rezola, fundador y socio Director de Datu(a) Smart Digital.

¿A qué os dedicáis en Datu(a)?

Acompañamos a nuestros clientes en el proceso de explotar el valor de los datos. Para ello entramos en empresas en las que, quizás, no tenemos el conocimiento funcional de cómo funcionan o qué es lo que hacen, pero nosotros sí tenemos la capacidad de entender la necesidad del cliente, disponemos de conocimientos de ‘machine learning‘ y ‘deep learning‘, y sabemos cómo se pueden adaptar estas tecnologías a las necesidades de las empresas. Les ayudamos a solucionar los problemas que puedan tener y a optimizar los procesos internos.

¿Nos puedes poner algún ejemplo de casos de éxito que hayáis llevado a cabo?

Un caso es el de GHI Smart Furnaces. Datu(a) ganamos el reto lanzado por esta empresa a través de Bizkaia Open Future. La problemática que planteaban era cómo predecir el momento óptimo de carga de chatarra de aluminio en hornos de fundición. No se puede echar toda la chatarra a la vez para ser fundida y la decisión depende de cuándo el operario considera que es el momento oportuno. En GHI quieren saber con información basada en datos, independientemente de lo que hace el operario, cuál es el momento óptimo para echar la chatarra de cara a maximizar la productividad toneladas/hora. Conociendo bien el proceso, las variables principales y cómo afectan a la productividad, nuestra propuesta consiste en generar un modelo para predecir cuál va a ser la productividad de cada colada en base a las diferentes variables.

Otro caso de éxito es el de CAF. Les estamos ayudando a desarrollar una herramienta que les permita conocer mejor el desgaste de componentes principales relacionados con los trenes. Conocer desgastes, la vida útil y desviaciones, de forma que si hay que tomar medidas correctivas, se pueda hacer lo antes posible. Se trata de minimizar mantenimientos y detectar desviaciones en el desgaste de componentes para evitar pérdidas económicas. Es mantenimiento predictivo y cálculo de vida útil de componentes. En el caso de los trenes, saber cuánto te va costar ese mantenimiento para hacer esos cambios es muy importante a la hora de plantear ofertas de ventas de equipos.

También trabajamos en el ámbito del procesamiento del lenguaje natural, ‘machine learning‘, redes neuronales y ‘deep learning‘. Más concretamente, en análisis de imágenes y texto. Gracias a estas herramientas somos capaces de procesar Información documental de más de 20 años, con una precisión del 90 por ciento. Evitas mucho trabajo manual y esa información que puedes procesar, como historias clínicas o información de seguros, se puede utilizar como datos para proyectar modelos complejos.

¿Qué es lo más importante a la hora de plantear la aplicación de inteligencia artificial a una analítica de datos?

Hay que disponer de datos preparados para hacer inteligencia artificial o planteamientos más avanzados. Apostamos por establecer modelos de gobernanza dentro de las organizaciones que son fundamentales a la hora de hacer una analítica básica. Hay que tener una base de datos única para una buena analítica. El problema es que si esa información no es correcta, no es diversa o no es buena, un sistema de IA no podrá aprender bien. Si los datos están mal o son malos, el modelo que vas a generar no va a ser mejor. Un modelo de inteligencia artificial o ‘machine learning‘ será tan bueno como la diversidad y la calidad de los datos que tenga para aprender.

Hablabas de gobernanza de los datos. También es muy importante todo lo que tiene que ver con la protección de la información.

La gobernanza de los datos se ha venido implantado porque a nivel legislativo se han impuesto determinadas normativas para la protección de datos. Cuando se habla de gobernanza de datos en las empresas parece que lo único importante es cumplir con las normativas y no se suele tener en cuenta su impacto a la hora de realizar una buena analítica. Está claro que necesito saber de dónde viene el dato y los permisos que tengo para tratarlo, pero también es importante que los datos tengan homogeneidad, integridad y calidad para poder trabajar sobre ellos. Por ejemplo, las direcciones: puedo rellenar un formulario y poner una dirección real o ficticia. A nivel de protección de datos da igual que sea correcta o no, pero a nivel de analítica, si no es correcto el dato, tengo un problema. El 70 por ciento del esfuerzo de un proyecto de inteligencia artificial se destina a la preparación de los datos para poder trabajar sobre ellos. Abogamos porque verificar la calidad de los datos no sea un proceso posterior, sino algo que esté establecido previamente y esté comprobado. Saber que el dato existe y es real.

¿Además de la analítica de datos mediante herramientas de inteligencia artificial, ofrecéis algún otro tipo de servicio a vuestros clientes?

Para nuestros clientes es muy importante tener en cuenta para qué quieren realizar esa analítica de datos. Nosotros queremos que visualicen dónde les gustaría estar dentro de unos años apoyándose en un Plan Estratégico. La explotación de datos y los proyectos de analítica de datos tendrán un impacto limitado si no existe un apoyo total desde la gerencia.

En cuanto a los sensores o dispositivos para captar y generar datos, no trabajamos directamente la parte ‘hardware’, pero sí tenemos ‘partners‘ en los que nos apoyamos así como una plataforma de ‘big data’ propia con capacidades de almacenamiento y computación escalables.

¿Cuánto tiempo suelen durar vuestros proyectos?

Hemos definido una metodología de trabajo concreta que nos permite hacer proyectos iniciales sin acometer demasiados costes al principio. Por muy grande que sea un proyecto, lo “rompemos” en pequeños proyectos de 2-3 meses de duración, y son proyectos incrementares. Si el proyecto inicial va bien, ponemos en marcha otro. La ventaja de esta metodología es que si algo no funciona se puede ver rápido y tomar las decisiones adecuadas. Por otra parte, por nuestra experiencia, en procesos de 6-8 meses los objetivos de la empresa no suelen ser los mismos que al inicio. Con esta metodología permitimos que cada 2 meses el proyecto pueda reorientarse hacia las necesidades que tengan las empresas.